Indice

La Smart Agriculture, ovvero agricoltura di precisione, rappresenta un modello innovativo di gestione delle attività agricole.

Esso, attraverso l’utilizzo di sensori, traduttori e sistemi hardware/ software permette di ridurre l’utilizzo di pesticidi e i consumi di risorse e di migliorare la qualità dei raccolti e dei prodotti finiti.

Le tecniche afferenti al Deep Learning, e in particolare le reti neurali convoluzionali (CNN, Convolutional Neural Network), si sono rapidamente affermate come lo stato dell’arte per task di image processing e computer vision.

Tra le numerose possibili applicazioni in grado di portare il concetto di Smart nel mondo agrifood sono a titolo esemplificativo le seguenti:

la detection di patologie per individuare preventivamente le malattie sulle piante di una coltura;

l’ottimizzazione dell’irrigazione automatizzata;

il riconoscimento e la classificazione di contaminazioni su cereali e derivati.

L’evoluzione del concetto di Smart Cities, modello rappresentativo di gestione delle dinamiche della vita urbana (es. il traffico, la sostenibilità, la sicurezza) utilizzando principi di AI, ha condotto all’evoluzione e diffusione di applicazioni intelligenti in ambito agrifood.

Il concetto di Smart Agriculture, ha reso accessibile al mondo agrifood lo sviluppo dedicato di applicazioni originariamente pensate per ambiti più votati all’innovazione tecnologica. Le aziende con una maggiore propensione alla ricerca e sviluppo oggi possono differenziarsi sempre di più dall’impiego di metodologie tradizionali.

Tramite sensori wi-fi presenti in coltura o montati a bordo di droni, ad esempio, è possibile raccogliere dati e immagini ad alta risoluzione e informazioni dai terreni coltivati.

Dal livello di umidità del suolo alla salute delle piante, fino al livello di maturazione e molto altro ancora.

Tutti dati che, attraverso cloud e innovativi algoritmi di Deep Learning, possono essere analizzati per individuare livelli di salute, stress e insorgenza di malattie. Queste informazioni consentono di regolare meglio l’erogazione di acqua, pesticidi o fertilizzanti.

Secondo le proiezioni realizzate da Nesta.org, ci si aspetta nei prossimi anni un incremento nei fatturati derivanti da agricoltura fino al 20%, per un mercato globale che entro il 2022 potrebbe raggiungere il valore record di 11,23 miliardi di dollari.

Reti Neurali Convoluzionali al servizio della Smart Agriculture

I modelli di Deep Learning volti al riconoscimento di immagini e alla loro segmentazione si sono rivelati essere lo stato dell’arte, superando in performance le più affermate famiglie di algoritmi, e uno strumento estremamente trasversale in ambito Smart Agriculture.

È questo in particolare il caso delle CNN, una classe di architetture deep ispirata al funzionamento della corteccia visiva del cervello umano e largamente usata in computer vision.

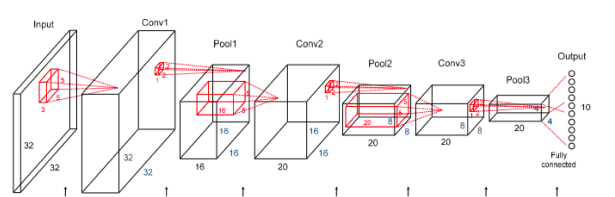

In generale le CNN sono formate da una sequenza di layer convoluzionali e di pooling, seguita da

livelli densi di classificazione. [1]

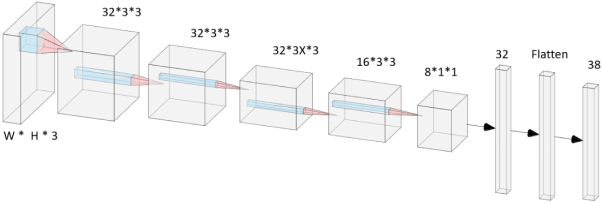

Schema architetturale di una CNN. Dopo lo strato di ingresso, gli strati convoluzionali e pooling si alternano fino all’ultimo strato completamente connesso che produce l’uscita della rete. [3]

Una convoluzione è definita da una matrice chiamata kernel e rappresenta un filtro applicabile sull’immagine di partenza. Tale matrice è generalmente di dimensioni minori rispetto all’immagine in input e si applica traslando il kernel su di essa, producendo come risultato una feature map. Ogni kernel richiede di ottimizzare in fase di training un numero di parametri così ricavabile:

Dopo un layer convoluzionale si utilizza solitamente un layer di pooling, necessario per eseguire una subsampling diminuendo le dimensioni dell’immagine in input e mantenendo le caratteristiche principali della stessa.

I livelli densi sono composti da una serie di livelli fully-connected che ricombinano le feature risultanti dai precedenti livelli convoluzionali.

Non è raro che una CNN contenga altri tipi di livelli quali droput, utilizzati per evitare l’overfitting e per aiutare la rete a generalizzare, o batch normalization utilizzati con lo scopo di normalizzare la variabilità nei batch di dati.

Le CNN sono applicabili a numerose applicazioni grazie al loro ridotto fabbisogno di pre-processing sull’immagine e di estrazione di feature rilevanti durante l’apprendimento, abbattendo così i costi di feature engineering. Inoltre, in letteratura sono ormai diffuse numerose varianti di reti pre-addestrate che sono già preparate per estrarre feature da immagini.

Qualità ed efficienza

Tutto il comparto agroalimentare del Made in Italy, gode dell’integrazione di tecnologie smart nei propri processi.

Le fotografie acquisite, arricchite e incrociate con dati rilevati da previsioni meteo e dal terreno, sono in grado di indicare e prevedere quali potranno essere i problemi che affliggeranno una coltura: bassa umidità e ridotto contenuto di minerali del terreno, eventuali epidemie di insetti dannosi.

L’AI è in grado di processare i dati che, possono restituire previsioni e stime utilizzando modelli matematici.

L’IA fornisce, un ambiente avanzato per integrare, correlare e analizzare in tempo reale i dati che si possono generare nelle varie fasi del ciclo di produzione dell’azienda.

Dall’intera piantagione si potrebbe spostare il focus sulla singola pianta.

Tramite l’utilizzo di droni capaci di muoversi in autonomia tra i filari e nelle piantagioni, diventerà possibile identificare ogni singolo frutto, con la massima precisione, e inviare in real-time i dati raccolti ad un server remoto dove verranno puliti, immagazzinati e processati fino a restituire delle mappe esplicative.

Detection di patologie sulle piante di una coltura

Si adoperano metodi di image processing per risolvere il problema della detection di malattie e infestazioni sulle piante di una coltura.

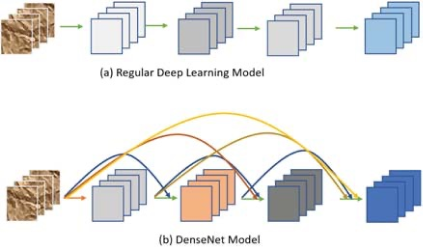

Nel corso degli anni sono stati proposti diversi metodi per affrontare questo problema, ma sempre con la necessità di integrare l’intervento umano per individuare correttamente le malattie. Le CNN sono risultate utili per approcciare task di desease detection. In particolare, si possono ottenere ottime performance e abbattere i costi di computazione per l’addestramento per questo task affidandosi a modelli di transfer learning basati sull’architettura di DenseNet. [2] DenseNet ha un design unico che connette ogni layer ad ogni altro layer in modo feed-forward. Se una CNN tradizionale ha L livelli con L connessioni, DenseNet presenta infatti tra ogni livello e il suo successivo.

Per ogni livello, le feature map di tutti i precedenti livelli sono utilizzate come input e così con i livelli seguenti. L’architettura di DenseNet ha una serie di vantaggi: allevia il problema della scomparsa del gradiente, rafforza la propagazione delle feature tramite i vari livelli, incoraggia il riutilizzo delle feature e riduce il numero dei parametri da trainare..

Un classico modello feed-forward (a) in cui l’output di ciascun layer è l’input del layer successivo è in genere meno performante di una struttura DenseNet (b) in cui l’output di ciascun layer è input di tutti i layer successivi. [2]

Fare transfer learning partendo dalla struttura base di DenseNet richiede l’aggiunta di un livello flatten e dei livelli di classificazione fully-connected. Il limite di un modello come questo, per quanto relativamente snello e performante rispetto ai classici modelli di deep learning, rimane comunque quello di dover sfruttare servizi cloud per poter ricevere in tempo reale le predizioni prodotte dall’algoritmo.

Per rendere fruibile in real-time agli utenti uno strumento di questo tipo, che possa girare sui più comuni dispositivi mobile c’è bisogno di intervenire sulla struttura di DenseNet semplificandola e riducendo il numero di livelli presenti nell’architettura di partenza. [3]

Versione lightweight di DenseNet utilizzabile per risolvere task di Detection di patologie sulle piante di una coltura. [3]

Congiuntamente alla semplificazione dell’architettura è importante valutare il corretto threshold tra performance e dimensione delle immagini da dare in input al modello in diversi scenari. La qualità e la risoluzione delle immagini fornite in input alla rete influiscono infatti sul numero dei parametri da addestrare. Supponendo di avere un input di dimensione W x H x M e di aver impostato i valori di stride e padding a 1, una normale operazione in una CNN può essere calcolata come segue:

Se prendiamo un altro input con dimensioni W’ x H’ dove W < W’ e H < H’, possiamo osservare come il costo di un livello di una CNN che connette tutti i layer al layer di input sia piuttosto differente e che W’ x H’ richiede costi computazionali maggiori di un input W x H.

Una versione lightweight di DenseNet, con il giusto input size, riesce ad essere un modello sufficientemente leggero da essere accessibile anche su mobile pur mantenendo performance alte nella detection di malattie. In questo modo è possibile dotare direttamente il personale in campo di dispositivi con strumenti in grado di fornire un aiuto decisivo nel riconoscimento di insorgenze di patologie o infestazioni, restituendo informazioni ad altissima granularità che permettono di agire in maniera localizzata nella cura delle colture. Il modello è immediatamente utilizzabile su dispositivi IoT come tablet e smartphone.

Ecosostenibilità

La ricerca di standard sempre più alti di ecosostenibilità è una necessità impellente del nostro secolo.

Sperimentare e attivare pratiche virtuose di agricoltura di precisione, facendo leva sull’IoT, consente oggi di tenere sotto controllo, non solo la carbon footprint di un’azienda ma anche il suo impatto idrologico e microbiologico sugli ecosistemi.

Optare per soluzioni green contribuisce alla costruzione di un’immagine aziendale positiva, tramite valori di sostenibilità molto ricercati in un mondo che registra un sempre maggior interesse verso queste tematiche e dove i consumatori si orientano sul mercato in maniera sempre più consapevole.

Investire per ottimizzare la richiesta idrica delle coltivazioni ha effetti benefici a cascata sulle aziende che decideranno di lavorare in questa direzione. Una distribuzione idrica ragionata e modulata, in stretta relazione con le esigenze del terreno e della coltura in oggetto, è in grado di consentire, oltre al risparmio di risorse idriche pari al 30-50%, un minor consumo energetico e l’ottimizzazione dei concimi utilizzati.

Irrigazione di precisione automatizzata

La capacità delle CNN di processare efficacemente grandi set di dati rende possibile stimare con precisione il livello di umidità del suolo direttamente da immagini aeree.

Si stima che la quantità di acqua che viene assorbita dalle piante sia solo tra il 5% e il 30% rispetto al totale utilizzato. È possibile realizzare un modello che prenda in input immagini aeree di una coltura e restituisca in output una mappatura del livello di umidità nel suolo al fine di indirizzare l’irrigazione verso le aree più asciutte.

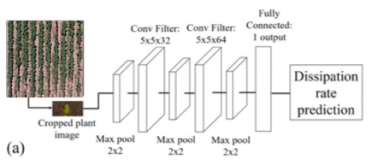

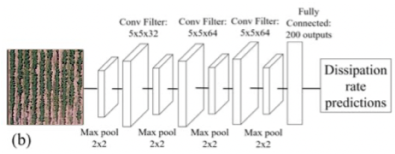

Per risolvere un task di questa portata si possono tentare due approcci basati sulle CNN:

- Il primo prevede di eseguire dei ritagli partendo dall’immagine area per individuare la singola pianta e stimare il dissipation rate,

- il secondo prende in input l’intera immagine aerea e restituendo come input tanti dissipation rate quante le piante in immagine.

Entrambi gli approcci prevedono un’architettura con due livelli convoluzionali e tre di pooling. Il secondo modello offre performance migliori in quanto dispone di informazioni su tutte le piante e quindi sulla correlazione tra queste e le condizioni del terreno.

In ogni caso, entrambi i modelli basati su CNN superano in performance algoritmi più classici come SVM. La particolarità di questo tipo di modello è che risulta essere molto robusto verso la presenza di rumore nelle immagini in input, caratteristica fondamentale per la sua efficacia in applicazioni reali.

Schema del primo modello (a) con crop della singola pianta in input e del secondo modello (b) con immagine dell’intero vigneto in input e dei modelli convoluzionali di input. [6]

Una volta addestrato il modello è possibile controllare il tasso di irrigazione basandosi sull’output prodotto. Se il modello predice un dissipation rate rispettivamente maggiore o minore di una arbitraria costante è possibile crescere o decrescere proporzionalmente il livello di irrigazione come di seguito:

Determinando sperimentalmente i valori per a = 1 e k = 0.25 è possibile risparmiare fino al 50% di acqua per l’irrigazione dirottando le risorse idriche verso le aree del terreno dove il dissipation rate risulta essere più alto. Un modello di questo tipo è già in uso nei vigneti di Symphony del Cowell Ranch in Snelling, California. L’alto livello di accuratezza con cui è possibile monitorare il livello di umidità del terreno rendono applicazioni come questa uno strumento fondamentale per l’ottimizzazione delle risorse.

Sicurezza

Il comparto agroalimentare, ha una relazione diretta con la salute delle persone.

Sistemi di identificazione dei contaminanti e dei difetti nei prodotti industriali possono essere applicati direttamente alla linea di produzione.

Tramite detector a raggi X, è possibile individuare in tempo reale qualsiasi tipo di non conformità agli standard richiesti tramite l’addestramento di precisissime reti neurali.

Si andrebbe così ad aumentare le garanzie fornite al consumatore finale sugli standard di qualità e sicurezza rispettati durante la lavorazione.

Riconoscimento di contaminazioni su cereali e derivati

Cereali come riso, frumento, mais soffrono spesso di contaminazioni da insetti infestanti.

Di conseguenza, anche i prodotti alimentare processati a partire da queste materie prime sono soggetti a simili contaminazioni, specie se lavorati in condizioni poco igieniche.

Riconoscere la presenza di questi insetti richiede l’analisi di centinaia di campioni di prodotto e il conseguente screening necessario per individuare la presenza di queste e altre possibili contaminazioni.

L’intero processo, se affidato solamente a personale umano, sarebbe estremamente oneroso in termini di tempo e costo, nonché suscettibile ad errori. Con l’avvento del Deep Learning e delle CNN che è stato possibile automatizzare efficacemente questo task. [4]

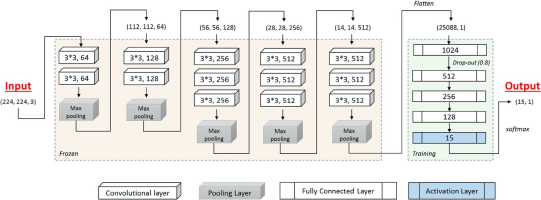

Si utilizza un modello di deep learning basato sull’architettura di VGG16, con i pesi addestrati sul dataset ImageNet e fare transfer learning per specializzare l’algoritmo nel riconoscimento di contaminazioni alimentari da insetti. [5]

La struttura base di VGG16 con i pesi dei livelli convoluzionali congelati e i livelli fully-connected che vengono specializzati durante l’addestramento. [5]

Si tengono congelati i pesi dei livelli convoluzionali durante l’addestramento, mentre i livelli fully-connected sono personalizzati e addestrati sul task specifico. Le immagini di input sono tagliate in modo da eliminare quanto più background possibile, effettuando un crop con aspect ratio 224×224: esattamente la dimensione dell’input richiesta da un modello come VGG16.

Le performance di un modello come questo riportano un tasso di errore inferiore al 10% e permettono di risparmiare tempo grazie alla capacità delle CNN di individuare le feature che meglio descrivono un’immagine in input.

Questo tipo di applicazione può già essere resa disponibile su dispositivi IoT in modo da essere utilizzata dagli operatori dell’industria alimentare in fase di screening, nonché dagli operatori sanitari in fase di investigazione.

In conclusione

Offrire queste possibilità al mondo agricolo vuol dire poter contribuire alla lotta intelligente alle fitopatie, alla mappatura dei campi, alla riduzione degli sprechi idrici ed energetici.

Applicazioni basate sulle CNN sono le più promettenti in questo campo: per quanto possano ancora risultare modelli pesanti da addestrare, rimangono la miglior classe di algoritmi in termini di performance e la meno costosa dal punto di vista umano in fase di implementazione grazie alla loro capacità di automatizzare la costruzione di feature rilevanti al task in oggetto.

In sintesi, possiamo identificare i benefici e le criticità di un approccio indirizzato alla Smart Agriculture nei seguenti punti:

Pro

Monitoraggio delle colture e del terreno tramite immagini aeree e real-time analytics

Maggiori capacità di screening di patologie e contaminazioni nella catena agroalimentare

Gestione ottimizzata di risorse idriche e fitofarmaci

Riduzione dell’impatto ambientale

Miglioramento della qualità dei raccolti e dei prodotti finiti

Contro

Necessaria integrazione di hardware in campo come sensori e droni

Dipendenza dalla qualità e dalla quantità dei dati a disposizione

Modelli da adattare per deployment su dispositivi IoT

References

[1] Zheng, C., Sun, D. W., & Zheng, L. (2006). Recent developments and applications of image features for food quality evaluation and inspection–a review. Trends in Food Science & Technology, 17(12), 642-655.

[2] Huang, G., Liu, Z., Van Der Maaten, L., & Weinberger, K. Q. (2017). Densely connected convolutional networks. In Proceedings of the IEEE conference on computer vision and pattern recognition (pp. 4700-4708).

[3] Ale, L., Sheta, A., Li, L., Wang, Y., & Zhang, N. (2019, December). Deep Learning Based Plant Disease Detection for Smart Agriculture. In 2019 IEEE Globecom Workshops (GC Wkshps) (pp. 1-6). IEEE.

[4] Karunakaran, C., Jayas, D. S., & White, N. D. G. (2004). Identification of wheat kernels damaged by the red flour beetle using X-ray images. Biosystems Engineering, 87(3), 267-274.

[5] Wu, L., Liu, Z., Bera, T., Ding, H., Langley, D. A., Jenkins-Barnes, A., … & Xu, J. (2019). A deep learning model to recognize food contaminating beetle species based on elytra fragments. Computers and Electronics in Agriculture, 166, 105002.

[6] Tseng, D., Wang, D., Chen, C., Miller, L., Song, W., Viers, J., … & Goldberg, K. (2018, August). Towards automating precision irrigation: Deep learning to infer local soil moisture conditions from synthetic aerial agricultural images. In 2018 IEEE 14th International Conference on Automation Science and Engineering (CASE) (pp. 284-291). IEEE.